ИИ может создавать дипфейки из защищенных фото: что показало новое исследование

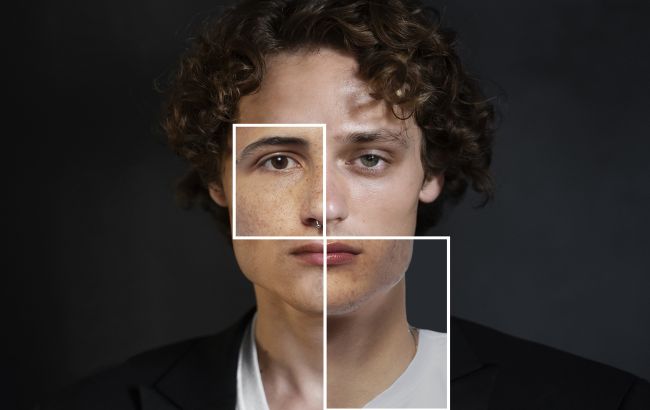

ИИ обходит защиту изображений (фото: Magnific)

ИИ обходит защиту изображений (фото: Magnific)

Исследовательская группа под руководством эксперта по кибербезопасности Бимала Висваната из Virginia Tech обнаружила серьезные пробелы в современных методах защиты визуального контента. Технологии, которые должны были бы мешать злоумышленникам использовать фото для создания дипфейков или обучения ИИ, можно с легкостью нейтрализовать.

Об этом информирует РБК-Украина со ссылкой на научное исследование, опубликованное на сервере препринтов arXiv.

Почему киберзащита больше не работает?

Ранее для обхода защитных фильтров на фотографиях (так называемого "защитного шума") злоумышленникам требовались специализированные знания и сложные алгоритмы. Новое исследование доказало: сегодня для этого достаточно обычных серийных моделей генеративного ИИ (off-the-shelf models) и простого текстового запроса.

Ученые протестировали различные системы защиты, включая:

Семантические возмущения: предназначенные для защиты идентичности лица.

Невидимый шум: накладываемый через латентное пространство ИИ;

Устойчивую защиту: специально разработанную для выживания во время дополнительного обучения нейросетей.

Результаты показали, что общедоступные ИИ-модели "image-to-image" не только обходят эти препятствия, но и делают это эффективнее специализированных хакерских атак. При этом сохраняются качество и полезность изображения для злоумышленника.

Фальшивое ощущение безопасности?

Исследователи отмечают, что на сегодня не существует математически гарантированного способа защитить публичные фото от копирования современными генеративными моделями. Это создает серьезные риски для цифровой приватности и подлинности контента.

"Действующие методы безопасности дают пользователям обманчивое ощущение защищенности", - отмечает автор исследования Бимал Висванат.

По его словам, любая будущая технология защиты должна проходить стресс-тесты именно с помощью простых текстовых атак через распространенные ИИ-модели, а не только через сложный специализированный софт.

Исследование ученых подсвечивает необходимость полного пересмотра подходов к кибербезопасности в сфере визуальных данных. Поскольку генеративные ИИ-модели становятся все более мощными, создание надежного "щита" от несанкционированного использования контента становится более сложной задачей.

Ученые убеждены: современное положение дел требует новых стандартов проверки устойчивости защиты мультимедиа.