Кибернетик Летичевский: Самая большая опасность ИИ - это агитация за "русский мир"

Кибернетик Александр Летичевский рассказал о развитии ИИ (коллаж: РБК-Украина)

Кибернетик Александр Летичевский рассказал о развитии ИИ (коллаж: РБК-Украина)

Искусственный интеллект стремительными темпами развивается по всему миру - его уже применяют для диагностики болезней в медицине, составления экономических прогнозов и даже синтеза новых веществ. ИИ не раз доказал, что способен превзойти человеческий разум. Однако, такие результаты многих настораживают и уже есть немало теорий о том, что одержат верх над человечеством.

О том, какое будущее ждет ИИ, может ли он представлять реальную угрозу человечеству, какие разработки проводят в Украине и как новейшие технологии на основе ИИ могут работать против нас в этой войне, рассказал заведующий отделом теории цифровых автоматов Института кибернетики имени В. Глушкова НАН Украины, доктор физ.-мат. наук Александр Летичевский эксклюзивно для РБК-Украина.

– Человечество достигло большого прогресса в развитии ИИ. Сейчас его уже используют практически во всех сферах, но пока эти технологии еще не совершенны. Каким вы видите будущее ИИ?

– Давайте определим, что такое искусственный интеллект. Технология нейронных сетей и технология машинного обучения - это лишь часть искусственного интеллекта. Еще в 60-е годы Виктор Глушков определил, что ИИ это прежде всего способность выводить факты из знаний, а не только машинное обучение на основе статистических алгоритмов.

Например, Chat GPT - учится на фразах. ИИ не думает, он выбирает слова по статистике, но это очень удачный выбор. Никакой семантики в выборе слов нет. Большое количество обучения может дать результат, но поскольку нет семантики, то есть вероятность ошибки.

Человек имеет дедуктивный способ восприятия мира. Также он учится на каких-то примерах, эмпирических наблюдениях, но он определяет семантику знаний, а технология нейронных сетей - нет. Например, если ребенку показать кошку, то он на всю жизнь ее запомнит, то есть создаст семантику, что это нежное животное на четырех лапах, которое мурлыкает. А машине нужно тысячу кошек показать, чтобы она научилась их узнавать. И это большая разница.

Chat GPT берет огромное количество текстовой информации из интернета, но она там скоро закончится и дальше будет заполняться текстами сгенерированными Chat GPT. Тогда чат станет насыщаться от себя и начнется деградация этой отрасли - он будет учиться на своих материалах.

Но вместе с тем, машинное обучение и нейронная сеть - это очень удачная разработка. Это изобретение столетия. Его можно сопоставить разве что с блокчейном (криптографическая база данных, которая заложена в основу Биткойна. - Ред).

Я вижу дальнейшее развитие искусственного интеллекта исключительно в сочетании нейронных сетей и дедуктивного мышления.

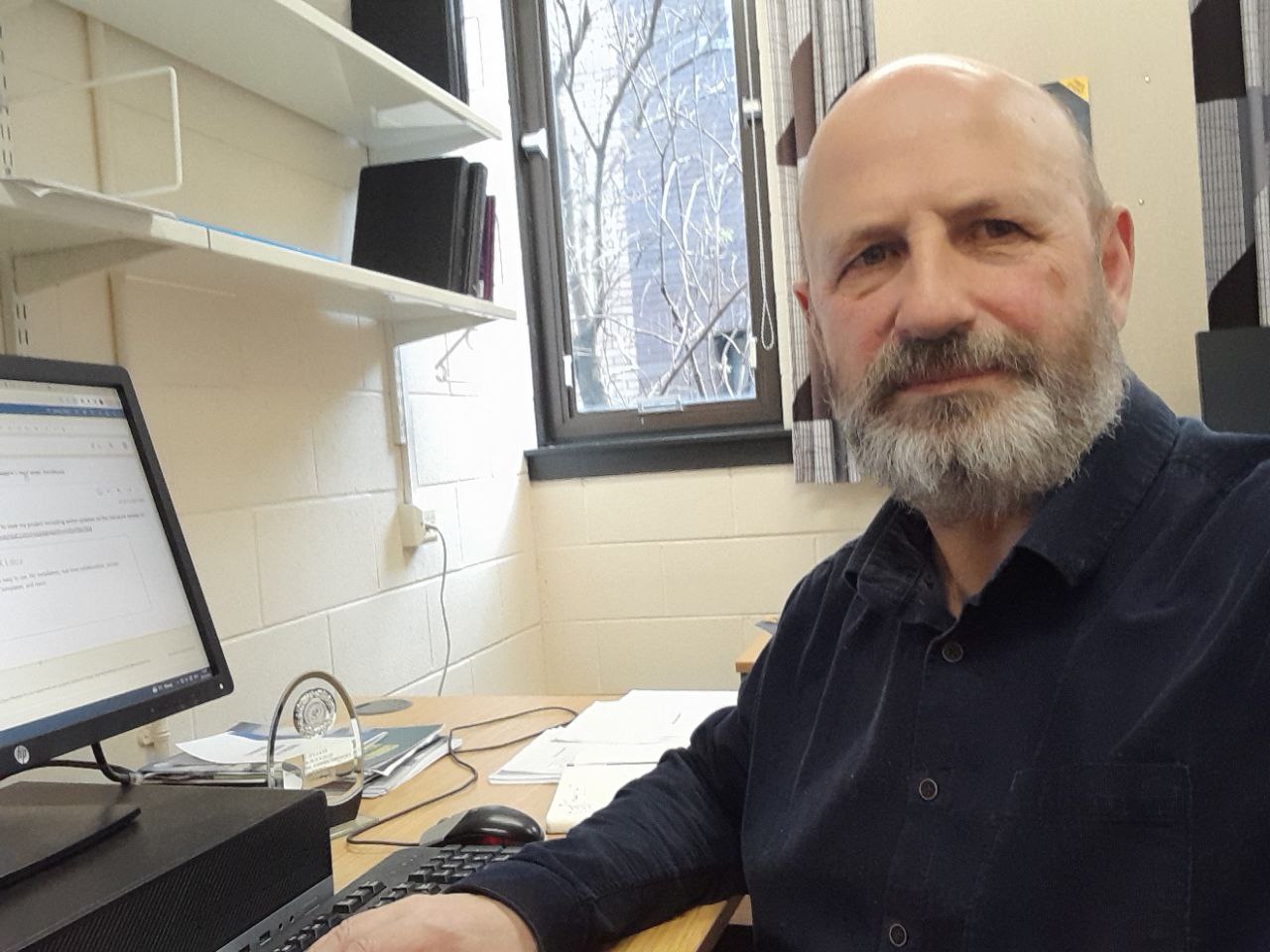

Заведующий отделом теории цифровых автоматов Института кибернетики имени В. Глушкова НАН Украины, доктор физ.-мат. наук Александр Летичевский (фото: visnyk-nanu.org.ua)

Заведующий отделом теории цифровых автоматов Института кибернетики имени В. Глушкова НАН Украины, доктор физ.-мат. наук Александр Летичевский (фото: visnyk-nanu.org.ua)

– В Украине сейчас ведутся разработки на основе ИИ? Чем вы занимаетесь?

– Мы работаем в области кибербезопасности. Искусственный интеллект помогает нам различать атаки на компьютер, сетевую среду. То есть мы изучаем трафик предыдущих атак, тренируем нейронную сеть и уже можем определить, что это за атака. Эта технология дает хорошие результаты. Но хакеры постоянно придумывают новые атаки, с этим тяжело сражаться.

Также хакеры могут маскироваться под нормальный трафик, такое трудно различать. Пока мы еще не преодолели эту проблему, но уже используем комбинацию нейронных сетей и дедуктивного обнаружения, потому что нейронной сети недостаточно.

Еще изучаем использование нейронной сети в научных экспериментах. В частности, в химии, физике. Здесь это уместно. Например, если нужно синтезировать некое вещество с определенными свойствами, то есть множество вариантов, как его можно получить. Таких комбинаций может быть бесконечное количество. И здесь помогут методы искусственного интеллекта - они подсказывают направление поиска на опыте предыдущих данных. Это ценное использование.

Также мы проводим исследования, с помощью которых нейросеть может показать, как человеческая клетка будет реагировать на некоторые ферменты при лечении рака. С этой технологией можно получать самый лучший сценарий, который приведет к тому, что опухолевая клетка погибнет.

– Какие профессии исчезнут из-за стремительного развития ИИ, потому что уже не будет потребности в человеческом ресурсе?

– Давайте вспомним всю историю человечества - профессии постоянно исчезают. Вот, к примеру, мультипликация. Сейчас появились автоматизированные программы, прекрасно создающие картинки, и это уже не Диснеевская мультипликация, которую когда-то рисовали годами. А те люди, кто раньше рисовал кистью, теперь переквалифицировались, как пользователи этих программ.

Я не верю, что исчезнут программисты, потому что писать программу на базе технологии, использующей только статистические методы, на основе которых строятся нейронные сети - это источник ошибок и неточностей. Я бы не пошел в такую ИТ-компанию что-нибудь заказывать.

В профессиях, связанных с аналитикой, где нужно изучать огромное количество литературы и делать выводы, ИИ большой помощник. Например, у юриста есть какая-то ситуация и для того, чтобы найти вердикт или объяснение, специалисты могут неделями работать. А Chat GPT, который сконфигурирован на юридическую тему, выдаст вам результат за секунды.

Поэтому действительно исчезнут определенные профессии, но ничего страшного в этом нет. На базе искусственного интеллекта будут уже новые профессии, которые придется человеку овладевать.

Александр Летичевский рассказал об украинских разработках на основе ИИ (фото предоставлено А. Летичевским)

Александр Летичевский рассказал об украинских разработках на основе ИИ (фото предоставлено А. Летичевским)

– В каких областях не стоит использовать ИИ и почему?

– Искусственный интеллект можно использовать везде, но он не должен быть последней инстанцией, особенно в критических областях, таких как медицина, военное дело, кибербезопасность. То есть там, где у нас нет права на ошибку.

В медицине, например, ИИ анализирует рентгеновские снимки и определяет наличие болезни. Но это не должно быть последним выводом. Еще должно быть слово врача, который действует согласно протоколу. ИИ может быть только как подсказка. Но о запрете ИИ в медицине - речь не идет, потому что он может действительно на что-то указать, что не заметил врач. Поэтому в критических сферах, где нужно принимать решения, от которых зависит жизнь людей, полностью доверять ИИ нельзя.

– А уместно ли применять ИИ в образовательной сфере? Если школьники и студенты будут писать контрольные или курсовые с его помощью, не приведет ли это к отупению молодежи?

– В Британских университетах при написании работ позволяют использовать Chat GPT только как справочник, но его нельзя использовать в студенческих работах. Уже есть программы, которые определяют, этот текст создал человек или Chat GPT. Эти технологии можно использовать в качестве подсказки, так как чат обрабатывает большое количество знаний и из этого можно делать выводы, которые будут полезны. Их нужно использовать только сознательно, анализируя корректность.

Школьникам можно разрешить только изучать что-то на основе ИИ, а делать контрольные они должны сами.

– Какие вы видите опасности в развитии ИИ?

– Уже сейчас ведутся разговоры о том, что системы ИИ нужно лицензировать так же, как лекарства или аттракционы. Они должны быть безопасны для того, чтобы их использовали в различных отраслях.

Есть определенная опасность для демократии. С чат-ботами можно создать много аккаунтов в соцсетях и они будут агитировать людей за определенные политические партии или подстрекать к неправомерным действиям. Люди очень эмоционально спорят, оскорбляют друг друга, а вот чат-бот толерантный, он будет аккуратно навязывать свое мнение. А это уже нападение на демократию. Это серьезная штука. Поэтому это нужно отслеживать и все сертифицировать, потому что это влияние на общее сознание в соцсетях.

– То есть надо ограничивать развитие искусственного интеллекта?

– Следует контролировать такие продукты и сертифицировать. Chat GPT не опасен, но люди начинают ему уже доверять, но там есть такие явления, как галлюцинации - вымышленные факты и события. Однажды я его спросил, знает ли он о моей статье о слонах, а он начал о ней что-то рассказывать, хотя у меня никогда не было такой статьи.

Мы не можем помешать развитию ИИ. Люди будут делать новые изобретения на его основе. Это все количественно перейдет в качество и на самом деле будет влиять на все сферы нашей деятельности.

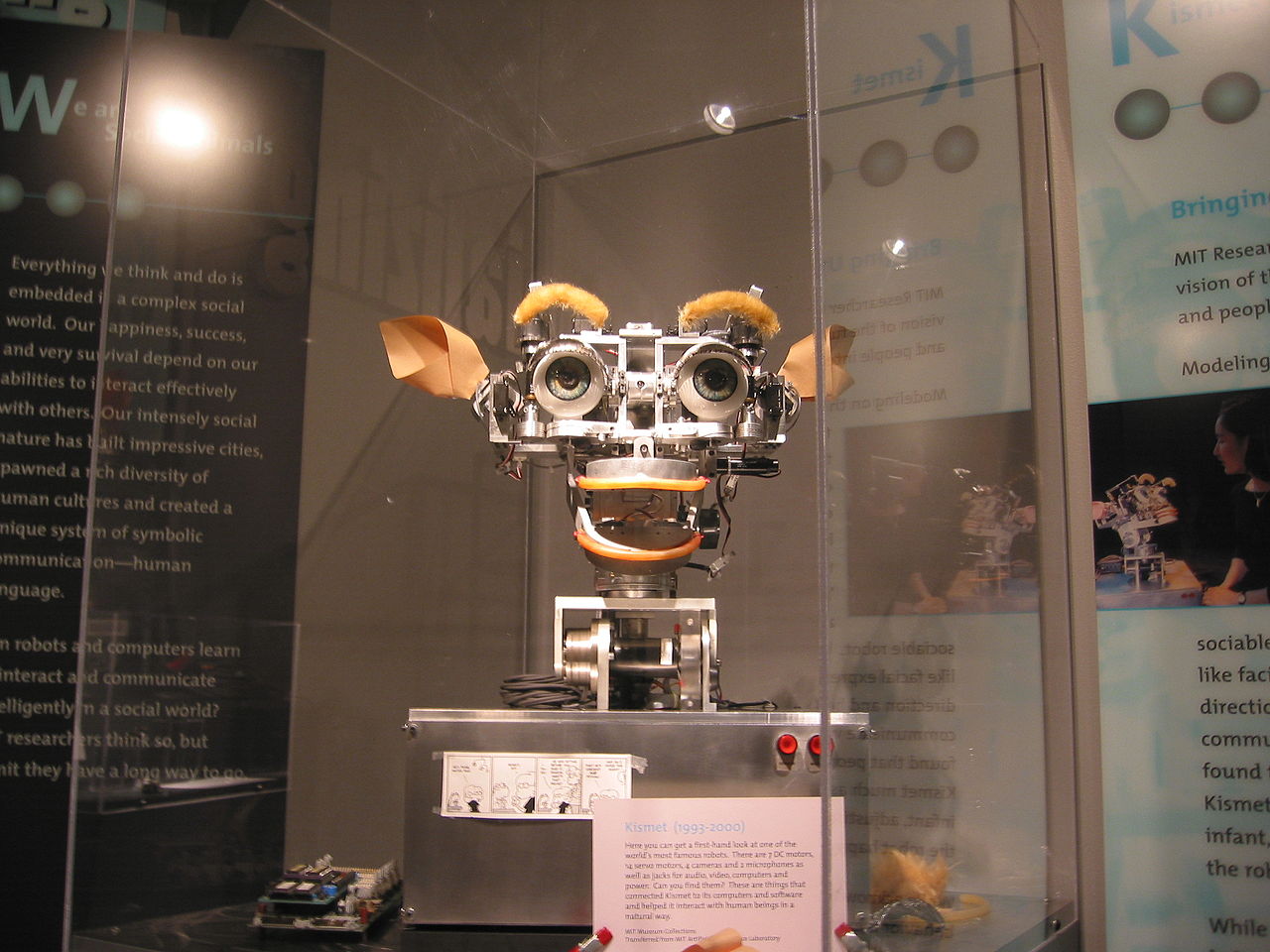

Kismet - робот с базовыми социальными навыками, созданный в конце 90-х годов в Массачусетском технологическом институте (фото: Википедия)

Kismet - робот с базовыми социальными навыками, созданный в конце 90-х годов в Массачусетском технологическом институте (фото: Википедия)

– Есть немало теорий о том, что ИИ сможет настолько развиться, что уничтожит человечество. Реальны ли такие опасности?

– Человечество можно будет цивилизационно уничтожить, если ИИ будет активно участвовать в соцсетях и будет влиять на обычных пользователей. На какую степень мы позволим ему вмешиваться в жизнь человечества, так это и будет. Если мы ему позволим запускать ракеты и давать такие решения на основе искусственного интеллекта, тогда, конечно, это опасно.

Но разговоры о том, что появятся какие-то фантастические работы, которые будут все уничтожать - до этого еще далеко. Хотя уже есть случай, когда однажды робот на складе ошибочно воспринял человека за товар и раздавил его своим манипулятором. Поэтому это все не должно контролироваться исключительно нейронными сетями. Если кто-то это позволит в критических сферах, то это будет преступление.

– Были ли еще случаи, когда применение ИИ навредило людям?

– Нейронные сети, которые плохо натренированы, совершают ошибки и, конечно, что они будут, потому что технология еще совершенствуется. Но больше роковых случаев не помню.

– Как может искусственный интеллект работать против Украины в войне? Вот недавно с помощью новейших технологий россияне создали реалистическое фейковое видео, на котором вроде бы как Главнокомандующий Залужный говорит, что идет против Зеленского...

– Да, сейчас действительно можно создавать такие фейки и имитировать чужие голоса. Но есть уже программы, которые могут различать, это, например, настоящий голос Залужного или нет. Программы также определяют фейки и по информации, потому что чат-бот - это специфическая машина, которая определенным образом формулирует фразы и эти характерные черты чата можно проявить таким же искусственным интеллектом, как и он.

Но самая большая опасность - это агитация за "русский мир", которая может быть в соцсетях. Можно переустроить и научить Chat GPT, потому что это доступная технология. И это очень небезопасно.

Фото, сгенерированное ИИ, которое массово распространили в интернете в январе 2023 года. Его опубликовали для иллюстрации последствий атаки россиян по жилом доме в Днепре. Этот "снимок" пошатнул доверие к украинцам со стороны иностранцев, поскольку он подыграл российским нарративам о том, что "трагедии у нас являются постановочными, а не настоящими" (фото: из свободного доступа)

Фото, сгенерированное ИИ, которое массово распространили в интернете в январе 2023 года. Его опубликовали для иллюстрации последствий атаки россиян по жилом доме в Днепре. Этот "снимок" пошатнул доверие к украинцам со стороны иностранцев, поскольку он подыграл российским нарративам о том, что "трагедии у нас являются постановочными, а не настоящими" (фото: из свободного доступа)

– Где целесообразно применять ИИ в Украине?

– Как я уже говорил, в медицине. В нашем институте есть хорошие разработки, позволяющие анализировать рентгеновские снимки больных. Также в криминалистике, когда полиции нужно различить лица на видео. В экономике можно моделировать и прогнозировать определенные сценарии. В научных исследованиях целесообразно использовать ИИ.

Нужно ли применять ИИ в творчестве - спорный вопрос. Если писать произведения, то это уже дело вкуса, разве что научить индивидуальному стилю. Будет ли это иметь какую-то ценность, то пусть уже решают специалисты по литературе. Когда-то я с удовольствием читал произведения машины, созданные еще в 80 годы. Они были очень близки к человеческим.

Если говорить об искусстве, то ИИ может создать невероятные картины, но это неосознанное творчество, под ним ничего нет. Никакого вложения души, какой-то человеческой черты - это все статистические методы. Как ИИ научили, так он на основе того и генерирует. Ничего нового он не создает, но эти картины могут быть очень эффектны.

Если мы научим музыке нейронную сеть, то она будет генерировать мелодии на основе тех, что ей показали. Но Бахов и Бетховенов мы от нее не получим.

– Можем ли в Украине создать что-то вроде Кремниевой долины?

– В Украине одни из лучших разработчиков программного обеспечения. Вы посмотрите, сейчас в хакатонах (форум разработчиков программного обеспечения - Ред.) побеждают выходцы из Украины. Поэтому думаю, что все еще будет. К сожалению, сейчас сложная ситуация. Но у нас можно и нужно строить Кремниевую долину. У нас очень серьезная школа программирования.

В 80-е годы Институт кибернетики был молодежным заведением. Это была своя Кремниева долина с огромным количеством направлений и систем. У того же Виктора Глушкова было много разработок, которые так и не были внедрены. У нас здесь была первая в мире персоналка, интернет, автоматическое доказывание теорем и еще много чего создано. У нас может быть такое и в будущем, если дать соответствующие условия.

Ранее мы делали большое интервью с астрономом Иваном Крячко из главной обсерватории НАН Украины об исследованиях космоса, колонизации Луны и Марса, и роли украинцев в этих исследованиях.

Читайте также наше интервью с академиком НАН Украины Яковом Дидухом о возобновлении экосистем на месте Каховского водохранилища, Чернобыле и изменениях климата в Украине.